【FactNote|數位素養誌】伊朗戰火下的AI宣傳戰+網攻近期鎖定記者和資安研究者

我是FactLink研究部主任李惟平。本人在FactLink負責讀書、做研究(I人的夢幻工作!),我也在美國馬里蘭大學兼任授課大眾傳播及社群媒體等課程。

在研究資訊操弄、AI與媒體素養的領域裡,永遠不缺令人興奮、驚訝,甚或不安的趨勢。從五月起,我們將不定期推出「FactNote|數位素養誌」,我會為大家精選點評較少被中文主流媒體報導,但是有趣或值得關注的議題、文章或報告,幫助大家掌握數位素養以及資訊操弄研究的大小事。此外,我也會在這裡中分享FactLink夥伴對媒體素養教育的觀察或體驗。(基本上,這就是一個FactLink筆記簿。)

如果大家對於這個專欄的文章有任何疑問、想法,我們非常歡迎大家留言分享或寫信交流。我們非常期待與您的互動。

現在,我來分享FactLink團隊在四月中觀察的重要趨勢以及推薦文章:

主題一:伊朗戰事中的AI宣傳戰

從二月底美國及以色列攻擊伊朗至今,戰事已逾兩個月。如前所說,戰事不只實體作戰,也是攻心之戰。這次伊朗戰事中的資訊交鋒,正好碰上AI技術大眾化的時機,更讓人關注AI扮演的角色。過去一個月,主流媒體如《紐約時報》、《Wired》,都發布了數篇對伊朗戰爭資訊戰的觀察報導,智庫亦持續監看、公布報告。

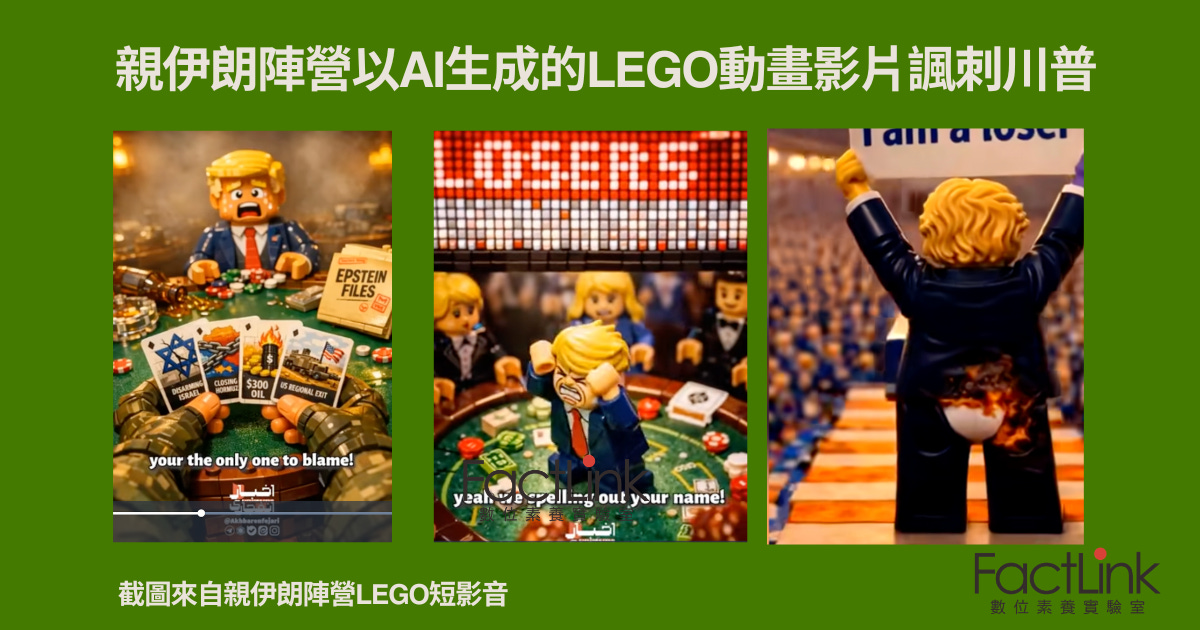

整體而言,較多意見認為美國在此次戰爭的資訊戰中,尚未做好準備。儘管美國政府在社群媒體頻發帖宣傳戰績或是駁斥網路不實傳言,但是親伊朗的力量,明顯在資訊宣傳戰佔上風。尤其是以AI製作、LEGO主題風格呈現的短影音,諷刺美國極為到位,不但在表達形式上吸睛,在內容上更是戳中了美國國際與國內政治的痛點。英美數家媒體找到了LEGO系列短影音的製作團隊,但該團隊聲稱一切獨立,與伊朗政府無關。無論如何,AI製作的迷因短影片,已經成為此次伊朗戰爭的宣傳利器。

除了LEGO系列外,更有許多AI製作,以假亂真的戰爭現場影片。總部位於英國倫敦的智庫戰略對話研究所(Institute for Strategic Dialogue ,簡稱ISD)發布報告,辨識兩大在X平台上宣傳有利伊朗訊息的網絡,兩大網絡旗下帳號獲得許多觀看數,其貼文大量使用AI製造圖文,誇大伊朗戰功,貶抑美國、以色列。貼文獲伊朗、俄羅斯官方熱烈分享,但ISD研究者很難證明該網絡與伊朗官方的直接關係。《紐約時報》報導則指出,伊朗此次的宣傳行動有高度的協同與組織運作,包括在關鍵時刻結合網紅與網軍,霸佔網路聲量,主導討論方向。

在伊朗戰爭中,使用AI、結合網紅宣傳、主導輿論節奏,實在值得關注與研究。若有興趣,以下是可供參考的幾篇文章,部分在閱讀付費牆內。

How pro-Iran networks gained a billion views on war propaganda,戰略對話研究所

Iran War: Monitoring the Online Threat Landscape,Graphika

伊朗在中俄協助下對美國和以色列展開信息戰,紐約時報

Cascade of A.I. Fakes About War With Iran Causes Chaos Online,紐約時報

War Memes Are Turning Conflict Into Content,Wired

主題二:記者、資訊研究者遭遇資安攻擊

《天下雜誌》日前刊出一篇調查報導,揭露過去一年中,中國間諜假稱為天下總編陳一姍,試圖接觸台灣網路媒體、智庫、議員,以及立法委員助理。除了陳一姍遭冒名網攻外,加拿大多倫多大學公民實驗室(The Citizen Lab)近期刊出調查,揭露中國惡意行動者如何假造記者與公民社會運動者的身分,展開網路跨國攻擊,其中有國際調查記者聯盟(ICIJ)兩名記者同遭中國間諜冒名。

The Citizen Lab調查,揭露中國惡意行動者如何假造記者與公民社會運動者的身分,展開網路跨國攻擊。The Citizen Lab的報告除了詳述惡意者的行動之外,也指出此惡意行動的背後,可能是中國政府結合特定民間公司或團體,以監控、駭入器材等方式,展開跨國鎮壓。

The Citizen Lab還在報告提出如何保護個人數位安全的具體建議。

台灣民主實驗室(Doublethink Lab)在2026年3月發布臉書公告提醒,發現有不明人士冒用該組織同仁的電子信箱,發送含有惡意程式的虛假活動邀請信件,該組織正採取相關防護與追查。

值得注意的是,美國ProPublica記者Robert Faturechi在2026年4月撰文表示,最近有人假冒他,與加拿大國防部官員及與烏克蘭有關係的拉脫維亞商人聯繫,似乎意欲取得情報。不過,Propublica 尚未確定假冒者真正的動機與國籍。

這些冒名攻擊,不但威脅被冒充者本身的資訊安全,也傷害特定對象與公眾對於記者、智庫、或公民社會的信任。若欲瞭解更多細節,請見以下報導或報告:

「天下總編」邀訪,還要送手機?假冒記者、議員,中國間諜在找什麼?天下雜誌

Tall Tales: How Chinese Actors Use Impersonation and Stolen Narratives to Perpetuate Digital Transnational Repression,加拿大多倫多大學公民實驗室

Who’s Been Impersonating This ProPublica Reporter?,美國ProPublica

這些內容有料:報告、文章、podcast

台灣民主實驗室的〈AI 在中國影響力作戰中的崛起:從中科天璣文件中得出的九大要點〉,整理從中國外洩的一份科技公司內部文件,分析中國情報資訊公司「中科天璣」(該公司有中國科學院計算技術研究所的背景)對台灣、美國、一帶一路國家、香港新疆西藏等資訊監控、分析及宣傳策略系統。雖然外界未能證實這些計畫是否得到實際採用,但仍能看出中方對於情資的策略與資訊蒐集使用方向。

IORG發布了2025 年中共官宣影片裡的「台灣代表」,呈現中共官媒常常提及、引述的台灣人士,例如鄭麗文、郭正亮、陳之漢等人。IORG報告指出,中共藉著引述這些人士的評論「以台批台」,宣揚兩岸和平統一論、提出疑美論及台灣國防失敗論等。

Podcast〈不好意思 請問一下〉也邀請IORG研究員及中國媒體低音播客討論近期中國的官宣,如何傳播鄭麗文訪中的論述,以及趁著美伊戰爭宣傳台灣的能源隱憂。

AI素養資訊補給站

已有不少研究證實,社群媒體助長社會極化。但生成式AI呢? 根據英國金融時報記者的實驗,也許AI可以減少社會極化。他指出,生成式AI 的答案較少宣傳陰謀論,給出的回答也偏向中道,所以也許可以比較不會把使用者推向極端? 不過,這只是初步的個人實驗。關於AI對社會極化的影響,有待更多研究驗證。

許多人都知道,不能完全信任AI給出的答案。不過AI模型與時俱進,正確度是否有改善? 紐約時報及華爾街日報最近報導,AI答案的正確度的確已有進步。問題是:使用者怎麼知道AI何時會出錯呢? 換句話說,即便AI答案的正確率達到80%,但使用者還是不知道自己何時會碰到那20%的機率。此外,研究者也發現,即便如Google 的AI Overview提供相關連結,該連結資訊也不一定正確。

另一個危險是,生成式AI的答案其實可被操弄,尤其是在網路缺少相關資訊時。為了證明這點,BBC播客節目The Interface主持人Thomas Germain寫了一篇部落格文章,假稱做為科技記者的他贏了美國南科達州的國際吃熱狗大賽。Germain隔天以Google搜尋最佳的熱狗大賽科技記者,Google結果「不負所望」,引述Germain自己的假文章,煞有其事指出Germain就是南科達州吃熱狗冠軍。

總而言之,對於AI給出的答案,還是要經過查核,不能盲信 (這點惟平老師常強調喔。)

感謝你的收看! 我們下次再見!

有話想對FactLink說? 歡迎來信給我們喔: public@factlink.tw